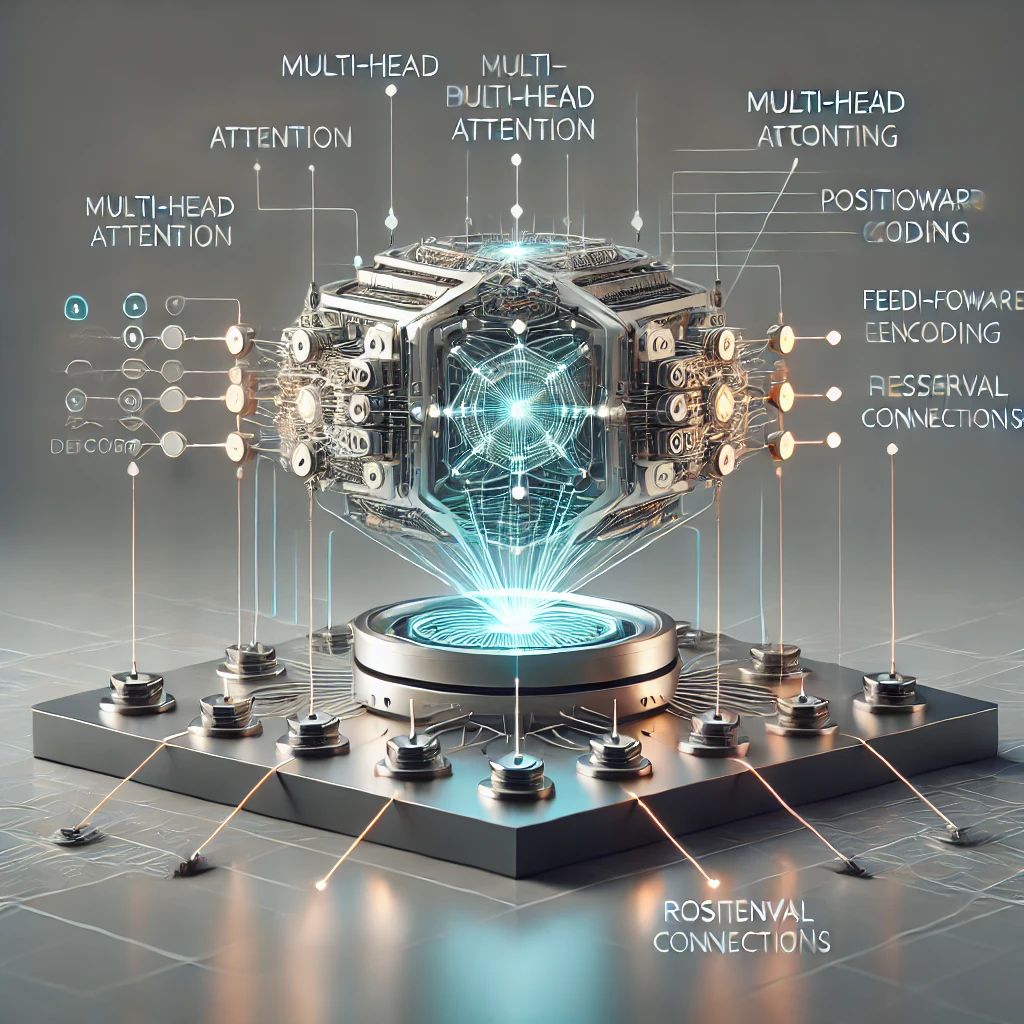

Transformer는 자연어 처리(NLP) 및 다양한 딥러닝 분야에서 혁신을 가져온 모델로, 2017년 Google의 연구팀이 발표한 논문 "Attention is All You Need"에서 처음 소개되었습니다. 이 모델은 기존의 RNN(Recurrent Neural Network) 및 CNN(Convolutional Neural Network)과는 다른 접근 방식을 통해 성능과 효율성을 크게 개선했습니다.1. Transformer의 핵심 개념1.1. Attention MechanismTransformer의 핵심은 어텐션 메커니즘입니다. 이는 입력 데이터의 모든 요소가 서로의 중요도를 계산해 작업에 필요한 정보에만 집중할 수 있도록 돕습니다. 특히, Transformer에서는 Self-Attentio..